Les fausses vidéos porno (deepfake porn).

Au cours d’une journée de travail chargée en mars, Kate, âgée de 28 ans, a senti un tapotement urgent sur son épaule. Son collègue a voulu lui montrer une vidéo. Elle a donc jeté un coup d’œil sur son ordinateur et a été choquée de voir son propre visage se retourner, grimaçant et gémissant. Elle est apparue à l’écran allongée nue sur un canapé, les jambes en l’air, pendant qu’un homme la pénétrait à plusieurs reprises.

Kate s’est sentie malade. Ses collègues, qui s’étaient rassemblés pour voir ce qui se passait, se turent aussitôt après avoir vu la vidéo. Cela paraissait réel et identifiait même Kate par son nom, mais elle savait que cela ne pouvait pas être. Au-delà de l’évidence – elle n’avait jamais fait de porno – elle pouvait dire que ce n’était pas son corps; seul le visage était le sien. Ce devait être une sorte de canular… mais est-ce que d’autres le croiraient?

«C’était horrible», a déclaré Kate, qui vit au Texas, à HuffPost. “Je n’aurais jamais rien vu de tel.”

La vidéo, qui est toujours en ligne et qui compte des dizaines de milliers de vues, est un deepfake – une vidéo trafiquée créée à l’aide d’un logiciel d’intelligence artificielle pouvant donner l’impression que quelqu’un fait ou dit quoi que ce soit. Les algorithmes Deepfake utilisent un ensemble de données de vidéos et d’images d’un individu pour créer un modèle virtuel de son visage pouvant être superposé et manipulé. Dans le cas de Kate, son visage a été échangé contre la tête d’une actrice porno.

«Quand il s’agit de Photoshop, il s’agit d’une image statique et il peut être très évident que ce n’est pas réel», a déclaré Kate, qui avait déjà été la cible d’attaques misogynes. «Mais quand c’est votre propre visage qui réagit et bouge, il ya cette panique qui dit que vous n’avez aucun contrôle sur la façon dont les gens utilisent votre image.»

Au début, le porno deepfake présentait presque exclusivement des célébrités féminines; leurs apparitions à la télévision et au cinéma ont donné aux créateurs de vidéos beaucoup de matériel avec lequel travailler. Mais maintenant que la technologie a évolué et est devenue plus largement accessible, les femmes ordinaires avec même une petite sélection de photos publiques ou de vidéos d’elles-mêmes sont également visées.

HuffPost a parlé à six femmes qui ont été insérées numériquement dans du porno sans leur consentement. Ceux qui sont cités ici sont identifiés par des pseudonymes pour protéger leur vie privée et s’expriment pour attirer l’attention sur un problème qui a été laissé à l’état de sombrer dans l’ombre.

Jusqu’à présent, la plupart des débats publics sur les deepfakes ont porté sur les problèmes politiques potentiels qu’ils pourraient poser à l’avenir, même s’ils représentent déjà une menace réelle pour les femmes. Les législateurs se sont inquiétés de la façon dont les vidéos pourraient hypothétiquement donner l’impression d’un candidat à la présidence de présenter un propos diffamatoire à la veille des élections de l’année prochaine. Les exploits satiriques de l’acteur Arnold Schwarzenegger et du PDG de Facebook, Mark Zuckerberg, ont récemment fait la une des journaux, annonçant les événements à venir.

Dans le même temps, la pornographie deepfake continuant de bouleverser la vie des femmes, la couverture médiatique a été faible et il n’existe toujours aucun recours pénal pour les victimes.

“Le mal causé aux femmes en ce qui concerne ce type d’objectivation sexuelle se produit maintenant”, a déclaré Mary Anne Franks, professeure de droit à l’Université de Miami et présidente de la Cyber Civil Rights Initiative. «C’est presque comme si les gens avaient oublié que c’était vraiment ce qu’avait été cette technologie et que la conversation autour des femmes s’est arrêtée».

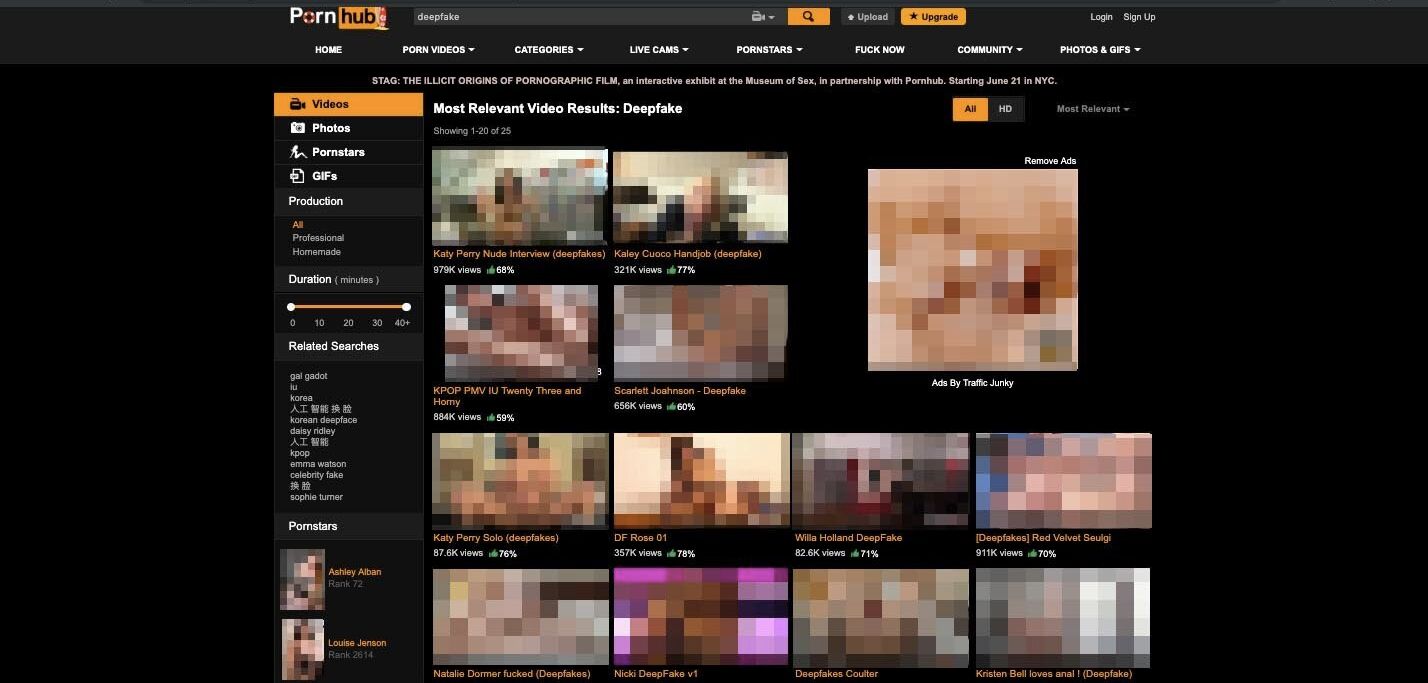

Les Deepfakes (fausses vidéos porno) ont été utilisés comme arme contre les femmes dès leurs existences. Le terme «deepfake» a été inventé en 2017 par un utilisateur anonyme de Reddit qui a partagé des vidéos porno trafiquées, comme celle ci-dessus, qui représente la star de «Wonder Woman», Gal Gadot. Aujourd’hui, les principaux sites Web pornographiques sont remplis de deepfakes, malgré les promesses de les interdire. (MindGeek, propriétaire de Pornhub et d’autres sites de vidéos érotiques, n’a pas répondu aux demandes répétées de commentaires sur la politique anti-deepfakes annoncée il y a plus d’un an.)

D’autres plates-formes technologiques ont hésité dans leur approche des deepfakes hébergés sur leurs sites, partagés entre des appels à éliminer la désinformation et à protéger la liberté d’expression. Au sein du gouvernement fédéral, les législateurs ont commencé à tirer la sonnette d’alarme au sujet des vidéos et quelques-uns ont présenté des projets de loi pour les réglementer, tels que la loi DEEPFAKES sur la responsabilité du représentant Yvette Clarke (D-N.Y.). Mais jusqu’à présent, aucun n’a abouti à une action.

Tina, une victime de porn deepfake dit.

Une fois que quelque chose est téléchargé, il ne peut jamais être réellement supprimé. Il sera simplement republié pour toujours.

Sans une telle intervention ou des politiques efficaces en place, deepfake porn a créé un espace confortable en ligne, et il est en plein essor. Outre les applications génératrices deepfake gratuites et faciles à utiliser, il existe désormais des moteurs de recherche de photos qui permettent aux utilisateurs de télécharger des photos d’individus afin de trouver des actrices porno dotées de fonctionnalités similaires pour des résultats optimaux. Il existe même des forums de pornographie «deepfake» où les hommes font des demandes payées pour des vidéos d’aspect professionnel de femmes spécifiques et échangent des liens vers les profils de médias sociaux des femmes pour des images sources. HuffPost a observé des demandeurs cherchant du porno avec des influenceuses Twitch, YouTube et Instagram, ainsi que leurs propres collègues, amis et anciens.

En mars, lors d’un de ces forums, quelqu’un a demandé une vidéo de sexe de Tina, une Canadienne âgée de 24 ans, et avait supprimé un lien vers sa chaîne YouTube. Quatre jours plus tard, un deepfake apparut qui semblait la montrer penchée nue sur un lit avec un homme poussant derrière elle et un autre caressant son pénis près de sa tête. La vidéo, qui est pratiquement transparente, contient toujours des milliers de vues.

«J’étais vraiment choquée et perturbée», a déclaré Tina, qui a appris l’existence de la vidéo lorsqu’une connaissance lui a envoyé un lien. “C’était vraiment bizarre et dégoûtant de voir mon visage là où il ne devrait pas être.”

L’affiche vidéo et le créateur revendiqué est un homme d’âge moyen, selon son profil. Tina n’a aucune idée de qui il est. Elle a envisagé d’essayer d’obtenir la vidéo, mais elle n’avait pas compris un problème c’est qu’elle avait déjà été partagée sur d’autres sites Web.

“Vous savez comment est Internet – une fois que quelque chose est chargé, il ne peut jamais vraiment être supprimé”, a-t-elle déclaré. “Il sera simplement reposté pour toujours.”

Cela pourrait arriver à n’importe qui !

Jusqu’à récemment, une manipulation vidéo convaincante, de type deepfake, ne pouvait être effectuée que par des monteurs hautement qualifiés. Les cinéastes hollywoodiens ont inséré numériquement des acteurs dans des films à titre posthume, par exemple, ce qui nécessitait une quantité considérable de métrages de visages. Maintenant, la technologie en évolution rapide a démocratisé ce type de pratique de montage vidéo trompeuse aux dépens des femmes. Nous sommes parvenus à un point où même les amateurs avec relativement peu d’images du visage de leur cible peuvent créer du porno deepfake par eux-mêmes.

Un créateur de vidéo autoproclamé, qui se décrit en ligne comme un Grec âgé de 25 ans et «l’un des premiers gars» à faire du porno deepfake, sollicite des dons et des demandes payées sur plusieurs forums. Les gens ont regardé ses vidéos plus de 300 000 fois.

Deepfakes n’est «pas différent d’une manipulation de photoshop ou d’un dessin / rendu d’artiste», a déclaré l’homme, qui n’a pas révélé son nom, à HuffPost. Lorsqu’on lui a demandé si quelqu’un lui demandait de supprimer les vidéos de sexe qu’il télécharge, il a répondu: «Il n’y a pas de takedowns.»

Malgré son mépris pour la vie privée des femmes, il semble plutôt soucieux de protéger la sienne: “J’accepte les paiements en bitcoins et autres monnaies cryptées (pas de carte de paiement / carte de crédit pour des raisons de confidentialité)”, a-t-il écrit dans un message. Dans une autre, il a indiqué que sa fourchette de prix se situait autour de 15 à 40 dollars par vidéo.

“Les femmes peuvent dire aux hommes:” Je ne veux pas sortir avec vous, je ne veux pas vous connaître, je ne veux pas me déshabiller pour vous “, mais maintenant, les hommes peuvent dire:” Oh oui? Je vais vous y obliger et si je ne peux pas le faire physiquement, je le ferai virtuellement », a déclaré Franks. “Vous ne pouvez vraiment rien faire pour vous protéger sauf d’exister en ligne.”

Elle espère que, à mesure que les gens deviendront de plus en plus conscients des deepfakes et du porno deepfake en particulier, ils deviendront plus sceptiques quant à ce qu’ils voient en ligne.

“Le seul point positif, si vous pouvez même appeler cela,” dit-elle, “plus les gens en savent, plus ils vont commencer à se demander si les [vidéos porno vengeance] sont réelles.”

Mais deepfakes a également élargi la menace du porno vengeur, ou du porno non consensuel. Un flot vindicatif n’a plus besoin de nus ou de cassettes sexuelles d’une femme qui l’a rejeté, ce qui lui a permis de fuir en ligne. Il lui faut juste ses photos Facebook ou Instagram pour s’imprégner de la pornographie existante. Et à mesure que ces vidéos deviennent plus faciles à réaliser, elles deviennent également plus difficiles à reconnaître.

Vous ne pouvez vraiment rien faire pour vous protéger sauf d’exister en ligne.

Mary Anne Franks, présidente de la Cyber Civil Rights Initiative.

Comme beaucoup de femmes, Amy, une mère et propriétaire d’une entreprise basée à Los Angeles, a été harcelée par le passé avec des images grossièrement modifiées qui étaient troublantes mais qui étaient clairement fausses. Elle n’avait jamais entendu parler de deepfakes jusqu’à ce qu’elle apparaisse dans une vidéo qui la décrit comme ayant des relations sexuelles et la qualifiant de «salope». Dans la section commentaires, des personnes ont félicité le créateur anonyme pour la crédibilité de la vidéo.

“Cela ne posait pas vraiment problème jusqu’à ce que la technologie et les compétences de ceux qui la composent s’améliorent au point que les gens pourraient croire que c’est bien moi”, a déclaré Amy. “Si nous voyons une vidéo de quelque chose, nous le prenons comme un fait.”

L’Agence de projets de recherche avancée pour la défense (DARPA), une branche du département américain de la Défense, s’emploie depuis plusieurs années à développer des algorithmes d’apprentissage automatique capables de détecter les vidéos manipulées, y compris les deepfakes. Une grande partie du défi consiste à suivre le rythme du logiciel deepfake au fur et à mesure de son évolution.

«À mesure que les outils de production de ces vidéos deviennent de plus en plus sophistiqués, nous devrons en avoir de plus en plus sophistiqués avec les nôtres», a déclaré Edward Delp, expert en criminalistique des médias à la Purdue University une récente interview. “Ce sera une course aux armements.”

Pas de vraies options pour les victimes

Maya, une femme de 29 ans qui vit également à Los Angeles, n’était pas consciente de sa présence dans le porno profond jusqu’à ce que HuffPost la contacte la semaine dernière. Elle était consternée d’apprendre la vidéo qui l’identifie par son nom et semble la montrer en train de se masturber. Mais elle n’a pas été entièrement surprise: elle a reçu beaucoup de messages d’étrangers demandant du sexe.

«Etre violé de manière aussi intime est vraiment un sentiment étrange», a déclaré Maya. «L’idée que les gens me sexualisent me donne le sentiment d’être fétichisée, de recevoir une attention indésirable, de perdre le respect en tant que personne et de ne plus être en sécurité.”

La triste réalité pour Maya et les autres femmes dans sa situation est qu’elles ne peuvent plus grand-chose à faire maintenant que les vidéos sont disponibles. Les poursuites peuvent coûter extrêmement cher. Pour intenter une action en justice pour harcèlement, usurpation d’identité, diffamation ou même appropriation illicite – qui ne concerne généralement que les célébrités -, vous devez savoir qui vous poursuivez. Comme beaucoup de victimes de la pornographie deepfake non consensuelle, Maya n’a aucune idée de qui a créé ou posté la vidéo d’elle.

Et comme les intermédiaires en ligne, y compris les géants des médias sociaux et les forums deepfake, sont dégagés de toute responsabilité vis-à-vis du contenu de tiers, conformément à l’article 230 de la Communications Decency Act, poursuivre en justice les sites hébergeant la vidéo serait également inutile. Les plates-formes ne peuvent pas avoir de problèmes juridiques pour ce que leurs utilisateurs publient et ne sont pas obligées de les supprimer. En conséquence, il est souvent vain d’essayer d’obtenir du contenu abusif hors ligne.

«Aussi décevant que cela puisse paraître, il n’ya pas beaucoup d’options pour les victimes», a déclaré Carrie Goldberg, avocate spécialisée dans la vie privée à caractère sexuel. Les sites Deepfake existent “pour monétiser l’humiliation des gens”, at-elle ajouté. “Cela souligne l’inconvénient de l’article 230 lorsqu’il existe des sites Web aussi arrogants au sujet de leur immunité de responsabilité.”

Comme les deepfakes malveillants sont généralement publiés de manière anonyme et conçus pour devenir viraux, les défenseurs des victimes, tels que Danielle Citron, exhortent les législateurs à élaborer une politique visant non seulement à punir les producteurs, mais également les distributeurs. Franks et elle travaillent ensemble à la rédaction d’un projet de loi pénale fédérale qui tiendrait les plates-formes responsables d’amplifier sciemment les canulars et de leur diffusion.

Les femmes sont réduites au silence:

La journaliste d’investigation Rana Ayyub a été témoin de l’effet de silence décrit par Franks. Au printemps dernier, elle a été victime d’une campagne de désinformation ciblée en Inde visant à l’intimider et à l’humilier.

L’abus a commencé le lendemain du jour où elle a publiquement condamné la réponse honteuse d’un parti politique au viol d’une jeune fille. Soudain, des captures d’écran montrant une série de tweets diffamatoires semblant faussement provenir d’Ayyub ont commencé à circuler en ligne. Elle a ensuite réalisé qu’une vidéo porno deepfake mettant en vedette son visage se répandait sur les réseaux sociaux, comme une traînée de poudre, à côté de son nom et de son numéro de téléphone. Il a été vu des centaines de milliers de fois et Ayyub a commencé à recevoir des appels et des messages demandant du sexe.

«C’était dévastateur», a-t-elle déclaré à HuffPost UK. “Tout le pays regardait une vidéo porno qui prétendait être moi, et je ne pouvais tout simplement pas me résoudre à faire quoi que ce soit.”

Même à présent que la vidéo a été démystifiée, Ayyub ne pourra jamais passer à autre chose. Elle ne peut pas réparer les torts causés à sa réputation et craint de se faire plus remarquer sur les réseaux sociaux.

«J’avais l’habitude d’être très avisé; maintenant, je suis beaucoup plus prudent sur ce que je publie en ligne. Je me suis auto-censurée un peu par nécessité », a-t-elle déclaré. “Je pense constamment:” Et si quelqu’un me faisait encore quelque chose? “”

Kate, la femme du Texas dont la collègue a découvert le porno deepfake, a également eu du mal à avancer. Lorsqu’elle a contacté son avocat, il a expliqué que l’affaire serait extrêmement difficile à combattre, car elle ne savait pas qui se trouvait derrière la vidéo.

En l’absence d’options légales viables sur la table, Kate s’est tournée à contrecœur vers le forum deepfake où la vidéo a été publiée et a demandé qu’elle soit supprimée. Le propriétaire du site lui a dit qu’elle n’était pas la seule femme sur la page, puis a cessé de répondre, a déclaré Kate. Elle se sentait désespérée.

«C’est grotesque de savoir qu’elle vit et que je ne peux rien y faire», a-t-elle déclaré. “Ces choses sont si terriblement crédibles et vous voulez désespérément dire:” Ce n’est pas moi! “Mais cela ne ferait qu’attirer davantage l’attention.”

Comme Ayyub, Kate a également commencé à limiter ce qu’elle partage en ligne, de peur que son contenu ne soit déformé et utilisé contre elle sans conséquence, encore une fois.

“Deepfakes pornographiques et porno vengeance et tout ce genre de choses ne feront que donner envie aux femmes de dire moins”, a-t-elle déclaré. “Au fur et à mesure que ces vidéos deviennent plus prolifiques et réalistes, est-ce que c’est quelque chose que nous allons simplement accepter comme coût pour être en ligne?”

Soyez le premier à commenter